Model Releases

Devstral Small 2: El Nuevo Estándar en Modelos de Código Open Source

Mistral AI presenta Devstral Small 2, un agente de código portátil de 24B parámetros con licencia Apache 2.0, optimizado para eficiencia y rendimiento en 2025.

9 de diciembre de 2025

Model ReleaseDevstral Small 2

Introducción: El Futuro del Desarrollo de Código

En el panorama acelerado de la inteligencia artificial, Mistral AI ha consolidado su posición con el lanzamiento de Devstral Small 2, una actualización significativa de su línea de modelos especializados en programación. Publicado el 9 de diciembre de 2025, este modelo representa un salto cualitativo en la capacidad de los agentes de software para operar de manera autónoma y eficiente.

Este nuevo modelo no es solo una iteración incremental; es un sucesor directo de Devstral Small 1, derivado de la arquitectura robusta de Mistral Small 3.1. Su diseño está enfocado en ser un agente de código portátil, lo que significa que puede desplegarse en entornos locales sin depender de la nube, reduciendo latencia y costos operativos para desarrolladores.

La relevancia de Devstral Small 2 radica en su equilibrio entre potencia y eficiencia. Mientras que los modelos de gran escala dominan los titulares, este modelo de 24B parámetros ofrece un punto de entrada económico para empresas que buscan implementar soluciones de IA sin comprometer la privacidad o incurrir en gastos excesivos.

- Fecha de lanzamiento: 2025-12-09

- Predecesor: Devstral Small 1

- Base arquitectónica: Mistral Small 3.1

Características Clave y Arquitectura

Devstral Small 2 está diseñado desde cero para la portabilidad. A diferencia de sus contrapartes cerradas, este modelo opera bajo la licencia Apache 2.0, lo que permite a los ingenieros modificar el código fuente, distribuirlo comercialmente y personalizarlo para casos de uso específicos sin restricciones legales.

La arquitectura se basa en una estructura de Mezcla de Expertos (MoE) altamente eficiente en hardware. Esto permite que el modelo procese tokens complejos con un uso reducido de memoria GPU, facilitando su ejecución en tarjetas de consumo o servidores empresariales estándar. La ventana de contexto se ha expandido para manejar archivos de código extensos y documentación técnica completa.

Además de las capacidades puramente textuales, Devstral Small 2 incorpora capacidades multimodales limitadas para interpretar diagramas de arquitectura y diagramas de flujo de datos, lo que es crucial para la refactorización de sistemas legacy.

- Parámetros: 24 Billones (24B)

- Licencia: Apache 2.0

- Ventana de Contexto: 128K tokens

- Capacidad Multimodal: Diagramas y Códigos

Rendimiento y Benchmarks

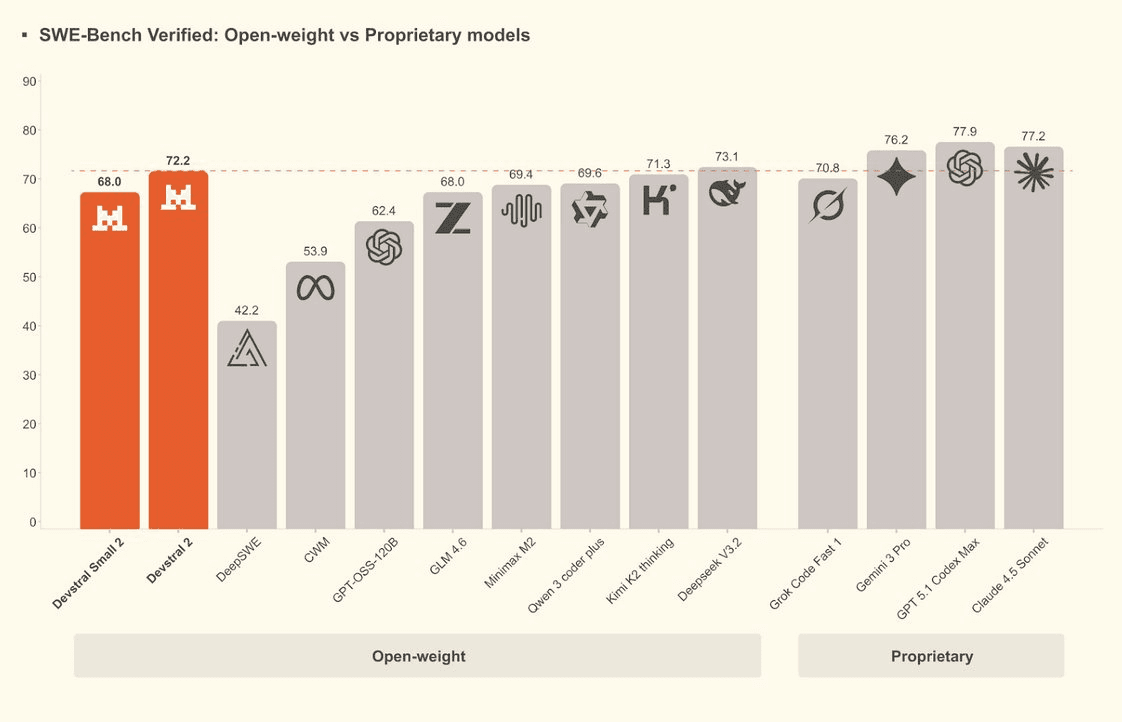

En términos de rendimiento, Devstral Small 2 demuestra una mejora notable sobre la versión anterior. Los tests internos y evaluaciones de la comunidad muestran que el modelo ha optimizado su precisión en tareas de razonamiento lógico y generación de sintaxis compleja.