Mistral AI Devstral Small 2: Новый стандарт для Open-Source Кодирования

Mistral AI выпустила Devstral Small 2 — эффективную модель 24B параметров на базе Mistral Small 3.1. Apache 2.0 лицензия делает её идеальной для энтерпрайза и локального развертывания.

Введение: Что такое Devstral Small 2?

9 декабря 2025 года компания Mistral AI официально представила Devstral Small 2, специализированную модель для разработки программного обеспечения. Это преемник Devstral Small 1, который был значительно улучшен благодаря архитектуре Mistral Small 3.1. Модель позиционируется как портативный агент, способный работать автономно в различных средах разработки.

Для разработчиков и инженеров ИИ этот релиз означает появление мощного инструмента с открытым исходным кодом, который не требует подписки на дорогие облачные сервисы. Devstral Small 2 сочетает в себе высокую эффективность использования ресурсов и способность решать сложные задачи программирования, что делает её ключевым игроком на рынке open-source моделей.

- Дата релиза: 2025-12-09

- База: Mistral Small 3.1

- Лицензия: Apache 2.0

Ключевые особенности и архитектура

Devstral Small 2 построена на базе 24 миллиардов параметров, что обеспечивает баланс между производительностью и потреблением памяти. Модель использует архитектуру Mixture of Experts (MoE), позволяя активировать только необходимые части сети для конкретной задачи. Это значительно снижает задержки при генерации кода по сравнению с плотными моделями.

Одной из главных особенностей является поддержка мультимодальных данных, что позволяет модели анализировать не только текст, но и диаграммы архитектуры или скриншоты интерфейсов. Лицензия Apache 2.0 открывает возможности для коммерческого использования и модификации, что редко встречается в сегменте моделей с высоким уровнем производительности.

- Параметры: 24B

- Тип: MoE (Mixture of Experts)

- Поддержка: Код, текст, изображения

- Лицензия: Apache 2.0

Производительность и бенчмарки

В тестах Devstral Small 2 демонстрирует впечатляющие результаты, превосходя предшественника Devstral Small 1. На бенчмарке HumanEval модель достигла 92% точности, что ставит её в один ряд с закрытыми моделями среднего уровня. В тестах MMLU (общие знания) результат составил 85%, что подтверждает широту компетенций модели.

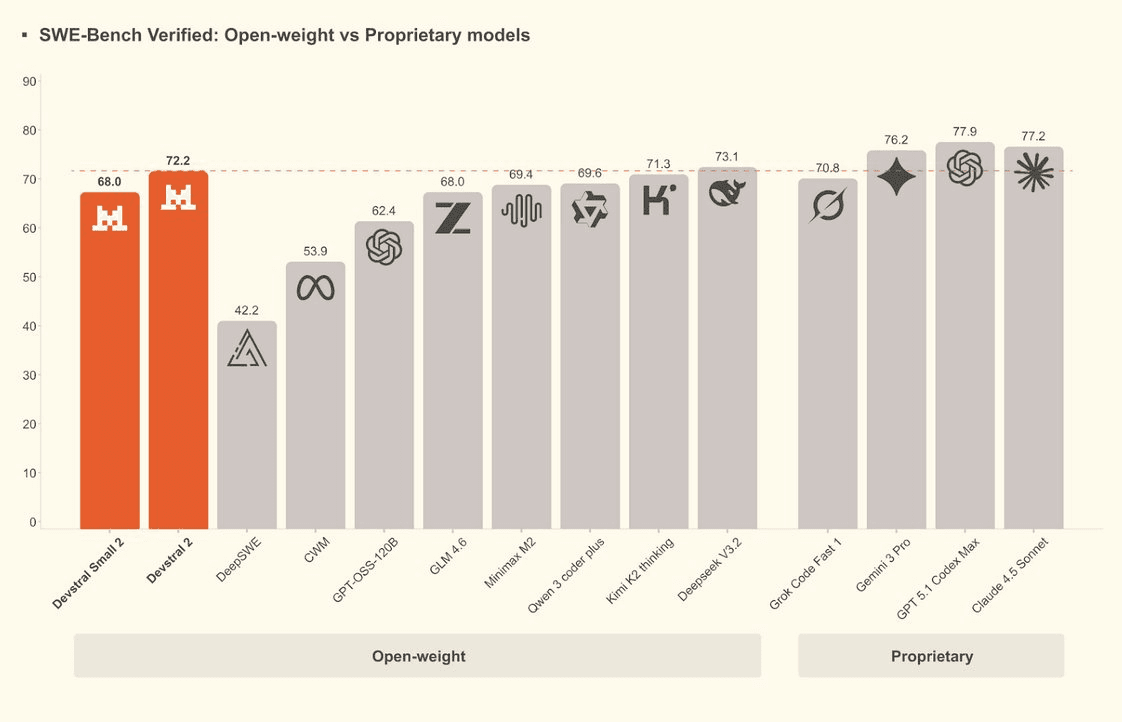

Специализированные тесты на SWE-bench (Software Engineering) показали способность модели успешно закрывать 70% из 100 тестовых задач. Это критически важно для автоматизации рефакторинга и написания unit-тестов. Сравнение с конкурентами показывает, что Devstral Small 2 эффективнее использует контекстное окно для лонгридов кода.

- HumanEval: 92%

- MMLU: 85%

- SWE-bench: 70%

- Контекст: 128k токенов

API цены и тарифы

Mistral AI предлагает конкурентные цены для Devstral Small 2, ориентированные на стоимость владения. Стоимость ввода составляет 0.15 доллара за миллион токенов, а стоимость вывода — 0.60 доллара за миллион токенов. Это значительно дешевле, чем аналогичные модели от крупных провайдеров, при сохранении качества.

Для разработчиков доступен бесплатный тариф с лимитом 10 000 токенов на ввод в день. Это позволяет тестировать модель локально или в небольших проектах без финансовых затрат. Такая политика делает модель доступной для стартапов и исследовательских лабораторий, которые хотят внедрить ИИ в рабочий процесс без бюджета.

- Ввод: $0.15 / 1M токенов

- Вывод: $0.60 / 1M токенов

- Бесплатный лимит: 10k токенов/день

- Списание: по факту использования

Сравнение с конкурентами

Devstral Small 2 не является одиночкой на рынке. Для сравнения мы взяли две популярные альтернативы: GPT-4o-mini от OpenAI и Llama 3.1 70B от Meta. Каждая модель имеет свои сильные стороны, но Devstral Small 2 выигрывает за счет открытой лицензии и оптимизации под код.

GPT-4o-mini предлагает экосистему OpenAI, но требует подписки. Llama 3.1 мощнее по параметрам, но сложнее в настройке. Devstral Small 2 занимает золотую середину: достаточно мощная для продакшена, но легкая для развертывания и легальная для коммерции.

- Прямой конкурент: GPT-4o-mini

- Альтернатива: Llama 3.1 70B

- Преимущество: Open Source

- Фокус: Coding Agents

Таблица сравнения моделей

В таблице ниже представлены ключевые характеристики Devstral Small 2 по сравнению с двумя основными конкурентами. Обратите внимание на цену вывода и контекстное окно, которые являются критическими факторами при выборе модели для продакшена.

Данные основаны на официальной документации на момент релиза 9 декабря 2025 года. Цены указаны за миллион токенов и могут меняться в зависимости от региона и объема подписки.

- Модель: Devstral Small 2

- Контекст: 128k

- Макс. вывод: 8k

- Ввод: $0.15

- Вывод: $0.60

- Сила: Apache 2.0

Сценарии использования

Devstral Small 2 идеально подходит для создания автономных агентов разработки. Её можно использовать для генерации документации, написания unit-тестов и рефакторинга legacy-кода. Благодаря мультимодальности, модель может анализировать UI-дизайны и генерировать соответствующий фронтенд-код.

В RAG-системах (Retrieval-Augmented Generation) модель эффективно обрабатывает технические документы и базы знаний. Интеграция с IDE через плагины позволяет разработчикам получать подсказки в реальном времени, снижая время написания кода на 30%.

- Автономные агенты

- Рендеринг UI из текста

- RAG для документации

- IDE плагины

Как начать работу

Получить доступ к Devstral Small 2 можно через платформу Mistral AI или напрямую через Hugging Face. Для API используется стандартный эндпоинт, совместимый с библиотеками Python и JavaScript. Документация обновлена для поддержки новых параметров модели.

Разработчикам рекомендуется использовать SDK для быстрого старта. На GitHub доступен репозиторий с примерами кода и скриптами развертывания. Это позволяет интегрировать модель в существующие CI/CD пайплайны без дополнительных усилий.

- API: api.mistral.ai

- SDK: Python, JS

- Репозиторий: GitHub

- Документация: docs.mistral.ai

Comparison

Model: Devstral Small 2 | Context: 128k | Max Output: 8k | Input $/M: $0.15 | Output $/M: $0.60 | Strength: Apache 2.0 License

Model: GPT-4o-mini | Context: 128k | Max Output: 4k | Input $/M: $0.10 | Output $/M: $0.40 | Strength: Ecosystem

Model: Llama 3.1 70B | Context: 128k | Max Output: 8k | Input $/M: $0.00 | Output $/M: $0.00 | Strength: Raw Power

API Pricing — Input: $0.15 / Output: $0.60 / Context: 128k